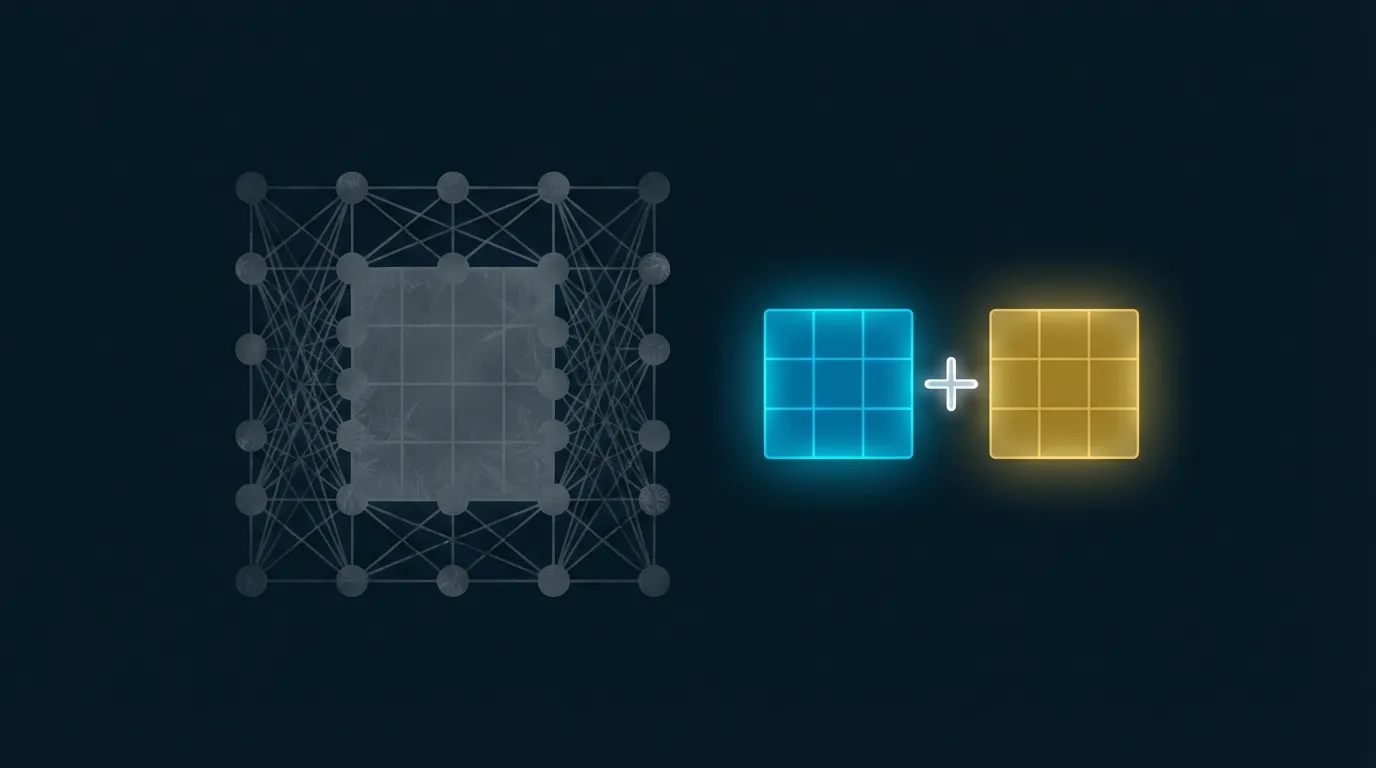

- 自監督學習(SSL)透過從無標註資料中自動建構監督信號,突破了人工標註的規模瓶頸——BERT[1] 的遮罩語言模型與 MAE[2] 的遮罩影像重建是兩大代表性範式

- SSL 方法可分為生成式(MLM、MAE)、對比式(SimCLR[4]、MoCo)與自蒸餾式(DINO[3]、BYOL[10])三大類,在 NLP 與 CV 領域均取得突破性成果

- Foundation Model[13] 的核心即「大規模自監督預訓練 + 下游微調」,BERT、GPT[5]、ViT[9] 等模型已成為現代 AI 的基礎設施

- 本文附兩個 Google Colab 實作:BERT MLM 預測與情感分類微調、MAE 影像遮罩重建視覺化,可直接在瀏覽器中執行

一、標註資料的瓶頸:為何自監督學習是 AI 規模化的關鍵

深度學習的成功仰賴大量高品質的標註資料,但人工標註面臨根本性的規模瓶頸。ImageNet 的 1400 萬張標註影像耗費了超過 25,000 人年的標註工作;醫學影像的專家標註成本更高達每張數十美元。當我們擁有數以十億計的網頁文本和圖片時,標註成為了最大的限制因素。

自監督學習(Self-Supervised Learning, SSL)提供了一條突破之路:從資料本身的結構中自動建構監督信號,讓模型在不需要人工標註的情況下學習有意義的表徵。其核心哲學是——

監督學習: 輸入 x → 人工標註 y → 學習 f(x) ≈ y

自監督學習: 輸入 x → 自動生成偽標籤 ŷ(從 x 的結構中提取)→ 學習 f(x̃) ≈ ŷ

典型的「偽標籤」策略:

文字: 遮罩部分 token,預測被遮罩的 token(BERT MLM)

影像: 遮罩部分 patch,重建被遮罩的像素(MAE)

語音: 遮罩部分時間步,預測被遮罩的語音表徵(wav2vec 2.0)

通用: 資料增強後的兩個視角應映射到相似表徵(對比學習)

SSL 的威力在於它解鎖了網際網路上幾乎無限的無標註資料。BERT[1] 使用 BooksCorpus + English Wikipedia(33 億 token)進行預訓練;GPT-3[8] 使用了 3000 億 token 的混合語料。這些規模的資料不可能靠人工標註取得,但自監督學習讓模型從中學到了豐富的語言與世界知識。

二、自監督學習全景:從 Pretext Task 到對比學習

自監督學習的發展經歷了從手工設計 pretext task 到通用框架的演進[12]。以下是當前主要方法的分類:

| 類別 | 核心思想 | NLP 代表 | CV 代表 | 優勢 |

|---|---|---|---|---|

| 生成式(Generative) | 遮罩或破壞輸入,重建原始資料 | BERT MLM[1]、GPT CLM[5] | MAE[2]、BEiT[14] | 直觀、訓練穩定、細粒度表徵 |

| 對比式(Contrastive) | 拉近正樣本對、推遠負樣本對 | — | SimCLR[4]、MoCo | 語義級表徵、遷移能力強 |

| 自蒸餾式(Self-Distillation) | 學生網路預測教師網路的輸出 | — | DINO[3]、BYOL[10] | 無需負樣本、自動湧現語義 |

| 去相關式(Decorrelation) | 最大化特徵維度間的獨立性 | — | Barlow Twins[17] | 概念簡潔、避免模式崩潰 |

| 判別式(Discriminative) | 區分真實 token 與替換 token | ELECTRA[16] | — | 樣本效率高、所有位置都學習 |

值得注意的是,最新的方法開始融合多種範式。DINOv2[15] 同時使用 DINO 的自蒸餾目標和 iBOT 的遮罩預測目標;BEiT[14] 結合了遮罩預測和離散 token 化。這種混合趨勢正在模糊方法類別之間的邊界。

三、文字 AI 的自監督革命:BERT 與 Masked Language Model

2018 年,Devlin 等人[1]提出的 BERT(Bidirectional Encoder Representations from Transformer 架構s)徹底改變了 NLP 的研究範式。它的核心創新是兩個自監督任務:

Masked Language Model(MLM)

隨機遮罩輸入序列中 15% 的 token,讓模型預測被遮罩的 token。這迫使模型理解雙向上下文——不同於 GPT 的單向自迴歸[5],BERT 同時利用左右兩側的資訊:

輸入: The cat [MASK] on the [MASK]

目標: 預測 [MASK] → "sat", "mat"

BERT 的遮罩策略(避免預訓練-微調不匹配):

被選中的 15% token 中:

80% → 替換為 [MASK] e.g., sat → [MASK]

10% → 替換為隨機 token e.g., sat → dog

10% → 保持不變 e.g., sat → sat

MLM 目標函數:

L_MLM = -E[Σ_{i∈masked} log P(x_i | x_\masked)]

BERT 架構:

BERT-Base: L=12, H=768, A=12, Params=110M

BERT-Large: L=24, H=1024, A=16, Params=340M

其中 L=Transformer 層數, H=隱藏維度, A=注意力頭數

Next Sentence Prediction(NSP)

給定句對 (A, B),預測 B 是否為 A 的下一句。這個任務旨在讓模型理解句間關係。但後續研究[6]發現 NSP 的效果有限——RoBERTa 移除 NSP 後反而取得更好的結果。

預訓練→微調範式

BERT 確立了「預訓練 + 微調」的兩階段範式,成為 Foundation Model[13] 的原型:

階段一:自監督預訓練

大規模無標註語料 → MLM + NSP → 通用語言表徵

階段二:有監督微調

加上任務特定的分類頭 → 少量標註資料微調

文本分類: [CLS] 表徵 → Linear → softmax

命名實體: 每個 token 表徵 → Linear → BIO 標籤

問答系統: 每個 token 表徵 → 預測 start/end 位置

語句相似度: [CLS] 表徵 → cosine similarity

BERT 在 11 個 NLP 任務上刷新 SOTA,

平均提升 2-7 個百分點,開啟 NLP 預訓練時代

BERT 的後繼者持續優化預訓練策略:RoBERTa[6] 移除 NSP 並使用動態遮罩與更多資料;ELECTRA[16] 以「替換 token 偵測」取代 MLM,讓模型從所有位置(而非僅 15%)學習,大幅提升訓練效率。

四、圖像 AI 的自監督突破:MAE 與 DINO

SSL 在 NLP 的巨大成功激發了 CV 領域的快速跟進。Vision Transformer(ViT)[9]提供了統一的架構基礎後,兩條路線在 CV 自監督學習中脫穎而出。

Masked Autoencoder(MAE):從遮罩中學習

He 等人[2]提出的 MAE 將 BERT 的遮罩預測思想優雅地遷移到視覺領域,但有一個關鍵洞察:影像的資訊冗餘度遠高於語言,因此需要極高的遮罩比例(75%)才能構成有意義的挑戰:

MAE 架構:

影像 → 切為 16×16 patch → 隨機遮罩 75% → 僅編碼可見 patch

↓

編碼器(ViT): 只處理 25% 的可見 patch(大幅減少計算)

↓

解碼器(輕量 Transformer): 可見 patch 編碼 + 遮罩 token → 重建像素

↓

損失: MSE(重建像素, 原始像素) 僅在遮罩位置計算

關鍵設計選擇:

1. 非對稱架構: 重型編碼器 + 輕量解碼器(解碼器僅用於預訓練)

2. 僅編碼可見 patch: 75% 遮罩 = 4× 計算加速

3. 像素級重建: 不需要額外的 tokenizer(相比 BEiT)

4. 隨機遮罩: 每次訓練迭代看到不同的遮罩模式

MAE 在 ImageNet-1K 上以純自監督預訓練取得了 87.8% 的 Top-1 精度(ViT-Huge),超越了之前的監督學習基準。更重要的是,它的訓練效率極高——由於只編碼 25% 的 patch,記憶體與計算需求大幅降低。

DINO:自蒸餾中湧現的語義

Caron 等人[3]提出的 DINO(self-distillation with no labels)走了一條不同的路線——自蒸餾。它最令人驚豔的發現是:自監督 ViT 的注意力圖自動學會了語義分割,無需任何像素級標註:

DINO 架構:

學生網路 g_θs ←── 梯度更新

教師網路 g_θt ←── 指數移動平均(EMA): θt ← λθt + (1-λ)θs

訓練流程:

1. 同一張影像 → 兩組不同的資料增強(crops)

- 全域 crops(224×224): 2 個

- 局部 crops(96×96): 若干個

2. 教師處理全域 crops → softmax(g_θt(x) / τ_t) (τ_t 小 → 分布尖銳)

3. 學生處理所有 crops → softmax(g_θs(x) / τ_s)

4. 損失: 交叉熵 H(p_teacher, p_student)

關鍵: 局部 crop 的學生要預測全域 crop 的教師輸出

→ 強迫模型從局部理解全域語義

DINO 的注意力圖 → 自動湧現物件邊界與語義分割

(無需任何像素級標註,純粹從自監督學習中湧現)

DINOv2[15] 進一步融合了自蒸餾和遮罩預測目標,在大規模策展資料集上訓練,產出了強大的通用視覺特徵——在分類、分割、深度估計等多項任務上無需微調即達到優秀表現。

五、Hands-on Lab 1:BERT Masked Language Model 預測與微調(Google Colab)

以下實驗使用 HuggingFace Transformers 進行兩項操作:(1) BERT MLM 的 fill-mask 預測,觀察預訓練模型的語言理解能力;(2) 在 SST-2 情感分類任務上微調 BERT,體驗「預訓練→微調」範式。

# ============================================================

# Lab 1: BERT — MLM 遮罩預測 + SST-2 情感分類微調

# 環境: Google Colab (CPU 即可, GPU 加速微調)

# ============================================================

# --- 0. 安裝 ---

!pip install -q transformers datasets torch

import torch

from transformers import (

BertTokenizer, BertForMaskedLM,

BertForSequenceClassification, Trainer, TrainingArguments

)

from datasets import load_dataset

import numpy as np

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(f"Device: {device}")

# ============================================================

# Part A: MLM Fill-Mask 預測

# ============================================================

print("\n" + "="*60)

print("Part A: BERT Masked Language Model 預測")

print("="*60)

tokenizer = BertTokenizer.from_pretrained('bert-base-uncased')

mlm_model = BertForMaskedLM.from_pretrained('bert-base-uncased').to(device)

mlm_model.eval()

# 測試句子

test_sentences = [

"The capital of France is [MASK].",

"Artificial [MASK] is transforming every industry.",

"The cat sat on the [MASK].",

"Self-supervised learning uses [MASK] data for pre-training.",

"BERT was developed by [MASK] AI research team.",

]

print("\n--- MLM Predictions ---")

for sentence in test_sentences:

inputs = tokenizer(sentence, return_tensors='pt').to(device)

mask_idx = (inputs['input_ids'] == tokenizer.mask_token_id).nonzero(as_tuple=True)[1]

with torch.no_grad():

outputs = mlm_model(**inputs)

logits = outputs.logits

mask_logits = logits[0, mask_idx[0]]

top5 = torch.topk(mask_logits, 5)

print(f"\nInput: {sentence}")

print("Top-5 predictions:")

for i, (score, idx) in enumerate(zip(top5.values, top5.indices)):

token = tokenizer.decode([idx.item()])

print(f" {i+1}. {token:15s} (score: {score.item():.2f})")

# ============================================================

# Part B: SST-2 情感分類微調

# ============================================================

print("\n" + "="*60)

print("Part B: BERT Fine-tuning on SST-2 Sentiment Classification")

print("="*60)

# --- 1. 載入資料 ---

dataset = load_dataset("glue", "sst2")

print(f"Train: {len(dataset['train'])}, Val: {len(dataset['validation'])}")

print(f"Sample: {dataset['train'][0]}")

# --- 2. Tokenize ---

def tokenize_fn(examples):

return tokenizer(examples['sentence'], truncation=True, padding='max_length', max_length=128)

tokenized = dataset.map(tokenize_fn, batched=True)

tokenized = tokenized.rename_column("label", "labels")

tokenized.set_format("torch", columns=["input_ids", "attention_mask", "labels"])

# 使用子集加速示範(Colab 友善)

small_train = tokenized["train"].shuffle(seed=42).select(range(2000))

small_val = tokenized["validation"]

# --- 3. 載入模型 ---

model = BertForSequenceClassification.from_pretrained(

'bert-base-uncased', num_labels=2

).to(device)

# --- 4. 訓練 ---

def compute_metrics(eval_pred):

logits, labels = eval_pred

preds = np.argmax(logits, axis=-1)

acc = (preds == labels).mean()

return {"accuracy": acc}

training_args = TrainingArguments(

output_dir="./bert-sst2",

num_train_epochs=3,

per_device_train_batch_size=32,

per_device_eval_batch_size=64,

eval_strategy="epoch",

save_strategy="no",

learning_rate=2e-5,

weight_decay=0.01,

logging_steps=50,

report_to="none",

fp16=torch.cuda.is_available(),

)

trainer = Trainer(

model=model,

args=training_args,

train_dataset=small_train,

eval_dataset=small_val,

compute_metrics=compute_metrics,

)

print("\nFine-tuning BERT on SST-2 (2000 samples, 3 epochs)...")

trainer.train()

# --- 5. 評估 ---

results = trainer.evaluate()

print(f"\n--- Results ---")

print(f"Validation Accuracy: {results['eval_accuracy']:.4f}")

# --- 6. 推論示範 ---

print("\n--- Inference Demo ---")

test_texts = [

"This movie is absolutely wonderful and inspiring!",

"The film was boring, poorly acted, and a waste of time.",

"An interesting concept but the execution was mediocre.",

"I loved every minute of this brilliant masterpiece.",

]

model.eval()

for text in test_texts:

inputs = tokenizer(text, return_tensors='pt', truncation=True, max_length=128).to(device)

with torch.no_grad():

logits = model(**inputs).logits

pred = torch.argmax(logits, dim=-1).item()

prob = torch.softmax(logits, dim=-1)[0]

label = "Positive" if pred == 1 else "Negative"

print(f" [{label} {prob[pred]:.2%}] {text}")

print("\nLab 1 Complete!")

六、Hands-on Lab 2:MAE 影像遮罩重建視覺化(Google Colab)

以下實驗使用 HuggingFace 預訓練的 ViT-MAE 模型,對真實圖片進行遮罩重建,視覺化原圖、遮罩圖與重建圖的三欄對比。

# ============================================================

# Lab 2: MAE — 影像遮罩重建視覺化

# 環境: Google Colab (CPU 即可)

# ============================================================

# --- 0. 安裝 ---

!pip install -q transformers torch pillow requests matplotlib

import torch

import numpy as np

import matplotlib.pyplot as plt

from PIL import Image

import requests

from transformers import ViTMAEForPreTraining, ViTMAEConfig, ViTFeatureExtractor

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

print(f"Device: {device}")

# --- 1. 載入預訓練 MAE 模型 ---

print("Loading ViT-MAE model...")

feature_extractor = ViTFeatureExtractor.from_pretrained('facebook/vit-mae-base')

model = ViTMAEForPreTraining.from_pretrained('facebook/vit-mae-base').to(device)

model.eval()

print(f"Model params: {sum(p.numel() for p in model.parameters()):,}")

# --- 2. 載入測試影像 ---

urls = [

"https://upload.wikimedia.org/wikipedia/commons/thumb/4/47/PNG_transparency_demonstration_1.png/280px-PNG_transparency_demonstration_1.png",

"https://upload.wikimedia.org/wikipedia/commons/thumb/a/a7/Camponotus_flavomarginatus_ant.jpg/320px-Camponotus_flavomarginatus_ant.jpg",

]

images = []

for url in urls:

try:

img = Image.open(requests.get(url, stream=True, timeout=10).raw).convert('RGB')

images.append(img)

print(f"Loaded image: {img.size}")

except Exception as e:

print(f"Failed to load {url}: {e}")

# 若載入失敗,使用合成影像

if len(images) == 0:

print("Using synthetic test images...")

img = Image.fromarray(np.random.randint(0, 255, (224, 224, 3), dtype=np.uint8))

images = [img]

# --- 3. MAE 重建函數 ---

def mae_reconstruct(model, feature_extractor, image, mask_ratio=0.75):

"""執行 MAE 遮罩重建"""

# 預處理

inputs = feature_extractor(images=image, return_tensors='pt')

pixel_values = inputs['pixel_values'].to(device)

# 前向傳播(模型內部會隨機遮罩)

with torch.no_grad():

outputs = model(pixel_values)

# 取得遮罩資訊

# ids_restore 和 mask 用於確定哪些 patch 被遮罩

mask = outputs.mask # [1, num_patches], 1=masked, 0=visible

pred = outputs.logits # [1, num_patches, patch_size**2 * 3]

return pixel_values, pred, mask

def visualize_reconstruction(pixel_values, pred, mask, image_size=224, patch_size=16):

"""視覺化原圖、遮罩圖、重建圖"""

# 計算 patch 數量

num_patches_per_side = image_size // patch_size

num_patches = num_patches_per_side ** 2

# 原圖(從 tensor 還原)

original = pixel_values[0].cpu()

# 反正規化

mean = torch.tensor(feature_extractor.image_mean).view(3, 1, 1)

std = torch.tensor(feature_extractor.image_std).view(3, 1, 1)

original = original * std + mean

original = original.clamp(0, 1).permute(1, 2, 0).numpy()

# 重建影像(從 patch 預測組合)

pred_patches = pred[0].cpu() # [num_patches, patch_size**2 * 3]

# 重排為影像

pred_img = pred_patches.re可解釋 AIe(num_patches_per_side, num_patches_per_side,

patch_size, patch_size, 3)

pred_img = pred_img.permute(0, 2, 1, 3, 4).reshape(image_size, image_size, 3)

pred_img = pred_img.numpy()

# 反正規化

pred_img = pred_img * feature_extractor.image_std + feature_extractor.image_mean

pred_img = np.clip(pred_img, 0, 1)

# 遮罩圖(灰色填充遮罩區域)

mask_np = mask[0].cpu().numpy() # [num_patches]

masked_img = original.copy()

for i in range(num_patches):

if mask_np[i] == 1: # 被遮罩

row = i // num_patches_per_side

col = i % num_patches_per_side

r_start, r_end = row * patch_size, (row + 1) * patch_size

c_start, c_end = col * patch_size, (col + 1) * patch_size

masked_img[r_start:r_end, c_start:c_end] = 0.5 # 灰色

# 組合圖:遮罩位置用重建,可見位置用原圖

combined = original.copy()

for i in range(num_patches):

if mask_np[i] == 1:

row = i // num_patches_per_side

col = i % num_patches_per_side

r_start, r_end = row * patch_size, (row + 1) * patch_size

c_start, c_end = col * patch_size, (col + 1) * patch_size

combined[r_start:r_end, c_start:c_end] = pred_img[r_start:r_end, c_start:c_end]

mask_ratio = mask_np.sum() / len(mask_np)

return original, masked_img, combined, mask_ratio

# --- 4. 執行重建並視覺化 ---

n_images = len(images)

fig, axes = plt.subplots(n_images, 3, figsize=(15, 5 * n_images))

if n_images == 1:

axes = axes[np.newaxis, :]

for idx, img in enumerate(images):

pixel_values, pred, mask = mae_reconstruct(model, feature_extractor, img)

original, masked_img, combined, mask_ratio = visualize_reconstruction(pixel_values, pred, mask)

axes[idx, 0].imshow(original)

axes[idx, 0].set_title(f'Original Image', fontsize=13)

axes[idx, 0].axis('off')

axes[idx, 1].imshow(masked_img)

axes[idx, 1].set_title(f'Masked ({mask_ratio:.0%} patches hidden)', fontsize=13)

axes[idx, 1].axis('off')

axes[idx, 2].imshow(combined)

axes[idx, 2].set_title('Reconstruction (masked patches filled)', fontsize=13)

axes[idx, 2].axis('off')

plt.suptitle('MAE: Masked Autoencoder — Image Reconstruction', fontsize=16, y=1.02)

plt.tight_layout()

plt.show()

# --- 5. 遮罩比例實驗 ---

print("\n--- Mask Ratio Experiment ---")

print("MAE 使用 75% 遮罩比例。讓我們觀察不同遮罩下的重建效果:")

# MAE 模型的遮罩比例由 config 控制,這裡展示標準 75%

# 在實際研究中,可以修改 config.mask_ratio 測試不同比例

pixel_values, pred, mask = mae_reconstruct(model, feature_extractor, images[0])

mask_np = mask[0].cpu().numpy()

visible_count = (mask_np == 0).sum()

masked_count = (mask_np == 1).sum()

total = len(mask_np)

print(f"Total patches: {total}")

print(f"Visible patches: {visible_count} ({visible_count/total:.1%})")

print(f"Masked patches: {masked_count} ({masked_count/total:.1%})")

print(f"\nMAE 的設計洞察:影像有高度空間冗餘,")

print(f"遮罩 75% 的 patch 才能迫使模型學習有意義的表徵。")

print(f"相比之下,BERT 只遮罩 15% 的 token——")

print(f"因為語言的資訊密度遠高於影像。")

print("\nLab 2 Complete!")

七、決策框架:企業如何選擇自監督學習策略

面對眾多 SSL 方法,企業需要根據自身資料類型、計算資源與應用場景做出選擇:

| 方法 | 模態 | 預訓練目標 | 計算需求 | 適用場景 | 下游遷移方式 |

|---|---|---|---|---|---|

| BERT[1] | 文字 | MLM + NSP | 中(4-16 TPU days) | 文本分類、NER、QA | 微調 + [CLS] 分類 |

| GPT[5] | 文字 | 自迴歸 CLM | 高(千 GPU days) | 文本生成、對話、推理 | Prompt / In-context |

| MAE[2] | 影像 | 遮罩 patch 重建 | 中(ViT-L 1600 epochs) | 影像分類、物件偵測 | 微調全模型 |

| DINO[3] | 影像 | 自蒸餾 + 多 crop | 中高 | 分割、檢索、零樣本 | 線性探針 / k-NN |

| SimCLR[4] | 影像 | 對比學習 | 高(需大 batch) | 通用視覺表徵 | 線性探針 / 微調 |

| wav2vec 2.0[11] | 語音 | 遮罩 + 對比 | 中 | 語音識別、說話者辨識 | CTC 微調 |

選擇 SSL 策略的決策邏輯:

決策樹:

1. 資料模態?

├── 文字 → 2a

├── 影像 → 2b

└── 語音 → wav2vec 2.0

2a. 文字任務類型?

├── 理解型(分類/NER/QA)→ BERT 系列(雙向編碼器)

└── 生成型(摘要/對話/翻譯)→ GPT 系列(自迴歸解碼器)

2b. 標註資料量?

├── 充足(>10K 標註樣本)→ MAE(微調後效果最佳)

├── 稀少(<1K 標註樣本)→ DINO(零樣本/線性探針更強)

└── 幾乎沒有 → DINOv2(凍結特徵 + k-NN 分類器)

3. 計算預算?

├── 有限 → 使用開源預訓練模型(HuggingFace Hub)

└── 充足 → 在 domain 資料上繼續預訓練(domain adaptation)

八、從預訓練到競爭力:SSL 的策略價值

自監督學習不僅是一項技術——它正在重塑企業的 AI 策略。Foundation Model[13] 的概念揭示了一個趨勢:大規模自監督預訓練模型成為 AI 基礎設施,如同電力和網際網路般不可或缺。

Domain-Specific Pre-Training

企業最具策略價值的 SSL 應用是領域特定預訓練:在通用模型的基礎上,使用企業專屬的未標註資料繼續預訓練,建立競爭對手難以複製的技術護城河:

領域預訓練範例:

生物醫學: PubMedBERT — 在 PubMed 論文上預訓練 → 生醫 NLP SOTA

金融: FinBERT — 在金融新聞與報告上預訓練 → 情緒分析 SOTA

法律: Legal-BERT — 在法律文件上預訓練 → 合約分析

程式碼: CodeBERT — 在程式碼-文件對上預訓練 → 程式碼搜尋/生成

通用模式:

開源基礎模型 → 領域語料繼續預訓練 → 少量標註微調 → 部署

投資回報:

✓ 解鎖企業內部的海量無標註資料(文件、日誌、影像)

✓ 大幅減少標註需求(從數萬降至數百)

✓ 建立難以複製的領域模型(資料即護城河)

✓ 統一多任務的表徵基礎(一次預訓練,多次微調)

SSL 對企業 AI 策略的啟示

對於評估 AI 投資的決策者,SSL 帶來三個關鍵啟示:

- 資料策略轉向:投資收集大量無標註資料(而非少量精標資料)的 AI ROI 評估 更高。企業應建立系統化的資料收集管線,而非昂貴的標註流程

- 計算投資的槓桿效應:一次預訓練投資可服務多個下游任務。預訓練成本雖高,但分攤到數十個應用場景後,單位成本遠低於為每個任務從零訓練

- 開源生態的策略利用:HuggingFace Hub 上有超過 50 萬個預訓練模型。企業不必從零預訓練——選擇最接近的開源模型,在領域資料上繼續預訓練,即可快速建立差異化能力

九、結語與展望

自監督學習是過去十年 AI 領域最重要的典範轉移之一。從 BERT[1] 的遮罩語言模型到 MAE[2] 的遮罩影像重建,從 SimCLR[4] 的對比學習到 DINO[3] 的自蒸餾,SSL 以多種形式證明了一個核心命題:資料的結構本身包含了豐富的監督信號。

回顧核心脈絡:

- 突破標註瓶頸:SSL 解鎖了網際網路上幾乎無限的無標註資料,BERT 和 GPT 系列的成功證明了資料規模的決定性作用

- 統一的預訓練框架:「遮罩-預測」範式(MLM、MAE、BEiT[14])在文字和影像領域展現了驚人的通用性

- 表徵品質的飛躍:自監督表徵在多數下游任務上已追平甚至超越監督學習,DINO 的注意力圖更展示了無監督語義理解的湧現

- Foundation Model 範式:大規模自監督預訓練[13] + 輕量微調已成為 AI 開發的標準流程

展望未來,SSL 的發展方向包括:多模態統一預訓練(如 ImageBind 統一六種模態)、更高效的預訓練方法(減少計算需求同時保持效果)、以及從靜態預訓練走向持續學習(模型在部署後持續從新資料中學習)。Transformer 架構[7]提供了跨模態的統一計算基礎,而 SSL 提供了跨模態的統一學習範式——兩者的結合正在催生真正的通用人工智慧基礎設施。